Сергей Анисимов

Поисковое продвижение сайтов

17. Распределение статических весов

Статический вес – это один из важных параметров, влияющих на продвижение сайта в целом и ранжирование конкретной страницы в частности.

Этот параметр рассчитывается индивидуально для каждой страницы и определяется количеством и качеством ссылающихся на страницу документов, к которым могут относиться html-страницы, pdf и. doc файлы, а также другие распознаваемые поисковыми системами документы с гиперссылками[64].

Вес можно разделить на внутренний (определяется количеством и качеством внутренних ссылок на страницу со всех других страниц и документов этого же сайта) и внешний (определяется внешними ссылками). Чем больше совокупный вес страницы, тем большую ценность она будет иметь в глазах поисковых систем.

SЕО-специалисты стараются всеми силами нарастить вес продвигаемых страниц. С «внешней» стороны проводится работа по наращиванию ссылочной массы (о чем мы поговорим позже). А для правильного распределения внутренних весов проводится оптимизация структуры сайта.

К каждому проекту в этом аспекте приходится подходить индивидуально, но общий принцип должен быть уже понятен: на все продвигаемые и важные страницы (услуги, категории, каталог, карточки товаров) должно стоять как можно больше внутренних ссылок. И наоборот – на нецелевые страницы (профили пользователей, технические страницы) должно вести как можно меньше ссылок (разумеется, без ущерба для удобства использования сайта).

Количественно статический вес страницы определить очень сложно, так как формулы, по которым он рассчитывается поисковыми системами, остаются неизвестными широкой аудитории. Однако это не мешает некоторым специалистам заниматься шаманством и пытаться рассчитать вес страниц с помощью каких-то формул, а на основе полученных результатов расставить внутренние ссылки на сайте. То же самое, с большим или меньшим успехом, делают специальные программы и плагины, которые автоматически расставляют ссылки на страницах сайтов, работающих на основе наиболее популярных в интернете CMS[65] (Content Management System, движок сайта).

В подобных расчетах мало смысла, так как они слишком примитивны по сравнению с математическим аппаратом, который используют поисковые системы. Однако о том, как сосредоточить вес на нужных страницах, нужно думать постоянно: в практике нередки случаи, когда добиться высоких мест по конкурентным запросам удается не в последнюю очередь благодаря правильной расстановке внутренних ссылок.

Рассмотрим несколько универсальных правил, которые помогут добиться нужного результата.

Закрываем ссылки на нецелевые страницы. Напомним, что на страницы, закрытые от индексации в файле robots.txt, лучше не ставить ссылок в пользовательской части сайта. Однако, если это все же необходимо, нужно скрыть ссылки на данные страницы посредством JavaScript таким образом, чтобы в исходном коде документов отсутствовали фрагменты вида «a href=«…».

Если в конкретном проекте это окажется сложно реализовать технически, можно попробовать закрыть ссылки на нецелевые страницы с помощью атрибута rel=«nofollow»[66]. Данный атрибут не является гарантией того, что поисковый робот не перейдет по ссылке (и не передаст вес), но это лучше, чем ничего.

Ставим ссылки на продвигаемые страницы в ручном режиме. На продвигаемые страницы следует поставить как можно больше ссылок внутри сайта. Тексты ссылок (анкоры) должны соответствовать запросам, по которым продвигаются страницы. Для простановки ссылок можно использовать:

– подвал сайта: сделать там блок с разделами каталога, поставить ссылки на продвигаемые товары и услуги);

– перелинковку (связывание страниц гиперссылками) в каталоге: блоки с самыми популярными товарами и категориями;

– виджеты, размещенные на всех внутренних страницах сайта (например, со списком услуг компании);

– основное меню сайта и другие элементы.

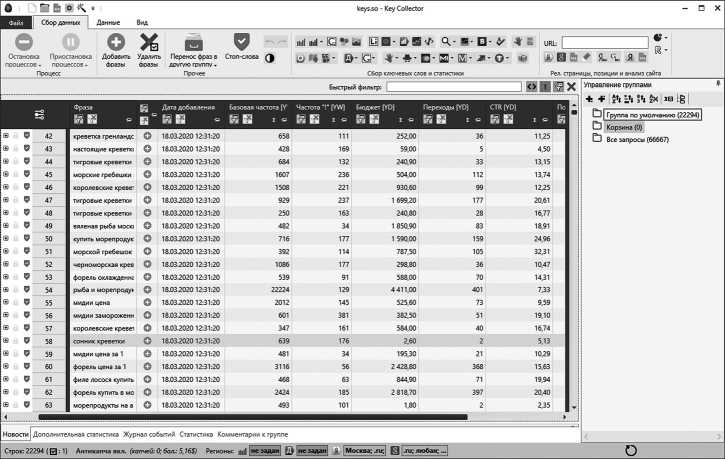

Ставим ссылки на продвигаемые страницы в автоматическом режиме. Неплохой вариант простановки ссылок в автоматическом режиме предложил в свое время Александр Люстик (создатель очень полезной программы KeyCollector[67]).

Рис. 5. Интерфейс программы KeyCollector – незаменимого помощника SEO-специалиста для работы с семантическим ядром сайта

Данный способ поможет увеличить посещаемость сайта с минимальными затратами и без риска санкций со стороны поисковых систем. Единственный недостаток алгоритма: он подойдет только для относительно больших проектов, уже имеющих неплохие показатели посещаемости и высокие позиции по ряду целевых запросов.

Суть алгоритма проста. Для больших проектов актуальна ситуация, когда одному и тому же запросу могут быть релевантны несколько страниц на сайте. Как уже упоминалось ранее, в таком случае поисковики могут понизить позиции сайта в выдаче. Поэтому необходимо собрать все эти страницы, выделить из них одну (наиболее релевантную, которая и будет показываться в выдаче) и поставить на нее ссылки с других релевантных страниц.

Таким образом мы повысим статический вес целевой страницы и подскажем поисковой машине, какой именно документ следует показывать в результатах поиска по целевому запросу. Особенно хорошо этот алгоритм может сработать при выходе сайта на «плато», когда, несмотря на усилия по продвижению, не удается повысить посещаемость сайта в течение долгого времени.

Приведем основные шаги, которые позволят реализовать алгоритм на практике:

1. Выгрузить из сервисов веб-статистики поисковые фразы, по которым пользователи заходили на продвигаемый сайт (например, за последние 3–6 месяцев).

2. Очистить полученный список:

a. Удалить запросы короче 2 и больше 4 слов.

b. Удалить «мусорные» запросы. Как правило, это запросы, содержащие цифры, латинские буквы, специальные символы (кавычки, наклонные черточки, звездочки и прочее). Чтобы ничего не пропустить, можно отсортировать список и выявить общие закономерности «мусорных» запросов.

c. Удалить низкочастотные запросы (как правило, это запросы с точной частотностью по Яндекс. Wordsial ниже 30–50, но все зависит от тематики). Опциально можно удалить и высокочастотные запросы.

Подробнее о формировании таких списков мы поговорим в разделе, посвященном формированию семантического ядра.

1. Кластеризовать (разбить на группы) полученный список запросов. Подробно об этом процессе мы поговорим в разделе, посвященном кластеризации запросов.

2. Получить позиции сайта по всем ключевым фразам. Выделить фразы, которые находятся в выдаче на 5-30-м месте. По таким запросам сайт с трудом дотягивает до зоны видимости, а то и вовсе не виден пользователям.

3. Определить наиболее релевантную страницу на сайте по каждому кластеру. Проще всего это сделать, задавая последовательно все запросы кластера в поисковую строку. Если поисковые машины в ответ выдадут одну и ту же страницу – берем ее. Если страницы будут разными – необходимо решить, какую из них целенаправленно продвигать. При выборе имеет смысл опираться на то, на какой странице конверсия будет выше.

В итоге получается список из кластеров, целевых фраз и соответствующих им страниц.

Далее, с помощью программиста, необходимо сделать скрипт, который будет сканировать сайт, находить целевые фразы в текстах и ставить под них ссылки на соответствующие страницы.

Сразу отметим, что многие описанные операции нужно автоматизировать. Сделать это можно с помощью КейКоллекто-ра, других программ или веб-сервисов, информацию о которых легко найти в Сети.

Приведенная последовательность действий является рекомендательной, и ее необходимо оптимизировать для конкретного веб-ресурса. Повторять алгоритм по автоматической расстановке ссылок можно каждые 3–6 месяцев, в зависимости от скорости публикации новых материалов.

Для автоматической расстановки внутренних ссылок можно воспользоваться и другими возможностями (например, специальным программным обеспечением). Однако работу таких средств нужно строго контролировать – в противном случае можно расставить ссылки неправильным образом и осложнить продвижение сайта.

18. Работа с внешними ссылками

Ссылки, которые ведут с продвигаемого сайта на сторонние ресурсы, называются внешними. Споры о том, что с ними делать, не утихают среди SEO-аналитиков уже долгое время.

Часть исследователей считает, что ссылки – это кровеносная система Интернета: их нужно размещать самостоятельно и поощрять к тому же пользователей сайта. Согласно анализу других экспертов, с внешними ссылками с сайта утекает статический вес, а следовательно, их надо ставить в минимальном количестве и закрывать от индексации.

Оптимальный подход должен учитывать оба приведенных полярных мнения. Внешние ссылки нужны, но к ним надо относиться внимательно: постоянно проводить мониторинг и избавляться от подозрительных или неоднозначных связей. Автоматизировать этот процесс непросто: большую часть работы приходится выполнять в ручном режиме.

Для начала необходимо сформировать список всех исходящих ссылок. Сделать это можно с помощью специальных программ (например, Xenu’s Link Sleuth[68]) или сервисов, информацию о которых легко найти в Сети.

После этого нужно выполнить следующие рекомендации:

1. Убедиться, что на сайте нет неизвестных ссылок. Это важно, так как «плохие» ссылки могут появиться без ведома владельца сайта, например, в результате взлома веб-ресурса или применения технологий ссылочного спама.

2. Все внешние ссылки должны быть модерируемыми. Это касается ссылок из комментариев, в ветках форума, разделов с вопросами, досками объявлений и других UGC[69] (user-generated content) элементов сайта.

Если для модерации не хватает ресурсов или времени, необходимо хотя бы закрыть ссылки с помощью атрибута rel=«nofollow».

3. Закрыть с помощью атрибута rel=«nofollow» рекламные и партнерские (особенно сквозные) ссылки. Также стоит закрыть от индексации ссылки на малопосещаемые ресурсы с низким уровнем траста.

✍ На заметку

Если на сайте есть ссылки, которые приходится закрывать с помощью атрибута rel=«nofollow», нужно задаться вопросом, а не проще ли их просто удалить? Нужны ли эти ссылки сайту и его посетителям?

4. Ссылки на высокотрастовые площадки (например, Википедию) и авторитетные в тематике ресурсы могут помочь в продвижении сайта. Таких ссылок не стоит бояться: они будут помогать пользователям найти нужную информацию, а сайту – увеличить уровень траста в глазах поисковых систем.

При этом нужно помнить, что ссылаться желательно на страницы, подходящие по тематике: контент документа, на которую ведет ссылка, будет служить сигналом релевантности исходной страницы.

5. Все внешние ссылки должны открываться в новой вкладке браузера (это можно сделать с помощью атрибута target=«_blank»[70]). В противном случае можно потерять часть пользователей, которые забудут вернуться на исходный сайт. А чтобы дать понять пользователю, что ссылка внешняя, рядом с ней можно поставить соответствующую пиктограмму.

Работа с внешними ссылками не ограничивается перечисленными рекомендациями: зачастую она требует творческого подхода и нестандартных действий. Чтобы выработать оптимальную стратегию, рекомендуется анализировать лучшие сайты в тематике: их методы работы с внешними ссылками помогут найти правильный вариант действий.

19. Перелинковка сайта и улучшение индексации

Перелинковка представляет собой связывание страниц сайта гиперссылками. Этот процесс затрагивает многие аспекты поискового продвижения: распределение статических весов, увеличение конверсии, улучшение поведенческой статистики.

В данной главе мы сосредоточимся на связи перелинковки с индексацией сайта поисковыми роботами и приведем рекомендации, которые необходимо внедрить на продвигаемом ресурсе.

Основное навигационное меню

Навигационное меню должно быть понятным и удобным. Для его реализации необходимо использовать HTML-теги: другие технологии могут помешать корректной индексации и ранжированию сайта.

Хлебные крошки

Хлебные крошки[71] – это строка со ссылками, соответствующими иерархии сайта.

Это привычный и интуитивно понятный элемент архитектуры сайта, который помогает пользователям и поисковым роботам понять, в каком разделе сайта они находятся. Хлебные крошки желательно использовать всегда, особенно если на сайте есть страницы с глубоким уровнем вложенности.

Желательно, чтобы хлебные крошки четко совпадали с адресацией, то есть на любой странице сайта можно было вернуться на уровень выше двумя способами: либо стирая часть адреса до ближайшей косой черты, либо кликая на последнюю ссылку в хлебных крошках.

Html-карта сайта

Html-карта сайта – это отдельная страница, на которой списком представлены ссылки на основные разделы сайта. Такая карта помогает поисковым системам тщательнее и легче индексировать основные разделы, в результате чего повышается их видимость. Также карта может быть полезна для пользователей, если они привыкли работать с этим инструментом.

Несколько простых рекомендаций, которые стоит учесть при создании этого раздела:

1. Формирование карты и поддержание ее актуальности должно выполняться в автоматическом режиме: добавлять ссылки в ручном режиме затратно и неудобно.

2. В карте сайта должны быть ссылки только на важнейшие страницы (разделы, категории, посадочные).

3. Ссылку на карту сайта лучше сделать сквозной. Размещается она, как правило, в подвале сайта.

Битые ссылки

Битые ссылки – это ссылки на несуществующую страницу или ресурс сайта (документ, изображение, видео, форму). При клике на битую ссылку пользователь понимает, что произошла ошибка (страница не найдена, изображение не отображается, видео не проигрывается).

Битые ссылки ухудшают впечатление пользователей о сайте, что напрямую может сказаться на поведенческих факторах ранжирования (например, вырастет показатель отказов). Слишком большое количество битых ссылок может означать брошенный сайт, что серьезно снижает показатели траста.

Для выявления битых ссылок существует множество сервисов, информацию о которых легко найти в Интернете. Однозначно стоит отслеживать битые ссылки в панелях вебмастеров поисковых систем. Также время от времени стоит сканировать сайт с помощью специального ПО, например, программы Xenu’s Link Sleuth[72].

Полнота индексации

Полнота индексации – это очень важный параметр, который характеризуется простой формулой: в индексе поисковых систем должны присутствовать все нужные страницы и не должно быть постороннего «мусора». Именно к этому состоянию нужно стремиться при продвижении сайта.

Контролировать полноту индексации достаточно просто:

1. Все целевые страницы должны присутствовать в индексе Яндекса. Проверить это можно с помощью панели вебмастера[73].

2. Все целевые страницы должны присутствовать в индексе Гугла. Проверить это можно также в консоли для вебмастера[74].

✍ На заметку

Если в индексе Яндекса и Гугла должны присутствовать все целевые страницы, но отсутствовать «мусор», логично предположить, что число страниц в индексе обеих поисковых систем должно быть примерно одинаковым.

Если это не так, у продвигаемого сайта могут быть проблемы.

Как правило, причин такой ситуации две:

– один или оба поисковика «не видят» целевые страницы или индексируют «мусор» (а иногда и то и другое);

– продвигаемый сайт попал под санкции, и страницы начали выпадать из базы.

Последний случай очень серьезный и требует неотложных мер для исправления ситуации.

3. В индексе поисковых систем не должно быть служебных поддоменов и страниц, дублей и прочего «мусора».

Полноту индексации иногда непросто проверить при работе с большими проектами. Для этого случая можно посоветовать проверять полноту по отдельным подразделам.

Коды ответа сервера

Все существующие страницы должны возвращать код ответа сервера 200 (ОК), а все удаленные или несуществующие документы – 404 (Not found).

Проверить выполнение этого правила можно с помощью специального программного обеспечения или веб-сервисов, информацию о которых легко найти в Сети.

Полезные советы и типичные ошибки

Перечислим некоторые типичные ошибки, которых стоит избегать, чтобы улучшить индексацию и перелинковку сайта:

1. На все ключевые разделы желательно поставить ссылку с главной страницы. Конечно, для масштабных информационных проектов и больших интернет-магазинов это может быть проблематично, но стремиться к этому необходимо.

2. Не следует ставить слишком много внутренних ссылок на одной странице.

Не так давно из-за технических ограничений поисковые системы не рекомендовали ставить больше 100–150 ссылок на странице. Сейчас таких жестких ограничений нет, поисковики лишь рекомендуют использовать «оправданное количество ссылок».

При этом нужно иметь в виду, что внутренний вес распределяется по каждой ссылке. Это значит, что если на странице 100 ссылок, то каждая получит 1/100 части веса, а если тысяча – лишь 1/1000. Кроме того, чрезмерное количество ссылок может восприниматься поисковыми системами как спам или попытка манипуляции выдачей, что автоматически приведет к наложению санкций.

Выводы:

a. Не стоит концентрироваться на точном ограничении количества ссылок.

b. Все ссылки нужно ставить для пользователей, а не поисковых роботов.

c. В пределах одной страницы ссылок не должно быть слишком много.

3. На все страницы сайта должен быть переход хотя бы по одной ссылке. Встречается ситуация, когда страница исчезает из навигационных цепочек, но остается доступной по прямой ссылке (например, при изменении каталога в интернет-магазине). Нужно быть готовым к тому, что такие страницы со временем выпадут из индекса.

4. В главе про улучшение скорости работы сайта мы говорили о важности использования http-кэширования[75]. Но использовать кэш важно не только для того, чтобы улучшить скорость загрузки.

Благодаря использованию нужных заголовков (один из пары Expires и Cache-Control max-age, а также один заголовок из пары Last-Modified и ETag) можно уменьшить объем передаваемого трафика за счет использования ресурсов из кэша, а не повторной их загрузки. Таким образом можно сэкономить краулинговый бюджет и улучшить полноту индексации сайта.

5. Не нужно использовать nofollow-ссылки во внутренней перелинковке. Это затруднит индексацию страниц сайта. Исключение составляют случаи приоритизации сканирования, когда для робота закрываются разделы, которые не имеет смысла индексировать (примером могут служить ссылки на вход, регистрацию или корзину на сайте интернет-магазина). Процитируем представителей Гугла: «Использование nofollow в таких случаях позволяет роботу заняться сканированием других страниц, которые вы хотели бы видеть в индексе Google. И все же гораздо важнее правильно организовывать информацию: применять интуитивно понятную навигацию, удобные для пользователей и поисковых систем URL и т. д.»[76].

6. Есть смысл подумать над использованием абсолютных (<a href=«http://site.ru/katalog»>Каталог продукции < /a>), а не относительных (<a href=«/katalog»>Каталог продукции</a>) внутренних ссылок.

Это поможет защитить контент от скраперов (парсеров) – мошеннических программ, которые воруют контент сайта и размещают его на других ресурсах.

При этом нужно помнить, что использование абсолютных адресов имеет ряд сложностей, которые встанут в полный рост при смене домена или протокола. Также сложно использовать абсолютные адреса при наличии нескольких доменов/поддоменов для разных языковых версий и при доработке сайта на тестовом сервере.

7. Следует использовать ключевые слова во внутренних ссылках. Мы уже касались этой темы в разделе про работу со статическими весами, но не лишним будет повторить: текст ссылки служит дополнительным сигналом релевантности. Нужно стремиться к тому, чтобы использовать в ссылке те ключевые слова, под которые оптимизирована страница.

8. Необходимо постоянно улучшать внутреннюю перелинковку:

a. Добавлять контекстные ссылки там, где это уместно.

b. Создавать рекомендательные блоки и виджеты.

c. Разместить в подвале сайты ссылки на важнейшие категории каталога и прочее.

Остается добавить, что приведенные рекомендации являются универсальными и подходят для любых типов проектов.

20. Повышение безопасности

К сожалению, в практике поискового продвижения нередко приходится сталкиваться с ситуациями злонамеренного взлома сайтов.

Взлом может быть сделан с разными целями, в том числе для понижения сайта-конкурента в результатах выдачи. Для этого случая, кроме простого удаления информации или нарушения программной работы ресурса (что легко исправить с использованием резервной копии сайта), могут использоваться и более тонкие приемы. Например, на взломанном ресурсе могут быть незаметно размещены материалы и ссылки, которые приведут к санкциям со стороны поисковиков. Простейший пример: размещение скрытого текста или ссылки на сомнительные сайты «взрослой» тематики и онлайн-казино.

Проникновение также выполняют безличные роботы, которые автоматически сканируют сайты на наличие типичных уязвимостей. Если такие уязвимости есть, сайт взламывается и на сервер закачивается вредоносный код или, например, страницы со ссылками на другие взломанные ресурсы и целевые сайты. Сети из таких взломанных сайтов могут достигать огромных размеров – до десятков, сотен и даже миллионов сайтов.

Чтобы избежать неприятных последствий, следует позаботиться о безопасности сайта. Рекомендаций здесь много, однако внедрить их без помощи профессионального программиста не всегда возможно.

Приведем некоторые приемы, которые помогут защитить сайт от взлома:

1. Проверить настройки сервера. Советы по безопасности легко найти для распространенных серверов, таких как Apache[77] или IIS (Internet Information Services) [78].

2. Составить список всего установленного ПО и регулярно его обновлять. Это касается как CMS, так и дополнительных сервисов, плагинов и программ.

3. Проверить сайт на наличие известных уязвимостей, например, межсайтового скриптинга (XSS, Cross-Site Scripting)[79] и SQL-инъекций[80].

4. Разграничить права доступа между всеми пользователями сайта. Ввести надежные пароли[81] и регулярно их обновлять.

5. Использовать безопасные протоколы для передачи данных между локальным компьютером и сервером (например, SSH и SFTP, а не обычными текстовыми протоколами без шифровки при аутентификации, например, Telnet или FTP).

6. Выбрать заслуживающий доверия хостинг и дополнительно проконсультироваться с его технической поддержкой о степени надежности сервера.

7. По возможности выполнить все рекомендации по безопасности, на которых настаивают разработчики CMS-сайта.

8. Следить за тем, что попадает с продвигаемого сайта в индекс поисковой системы. Если там обнаружатся подозрительные страницы и ссылки – следует немедленно принять меры.

Перечень средств защиты сайта постоянно обновляется. Нужно следить за появлением новых методик и по возможности внедрять их на продвигаемом сайте.